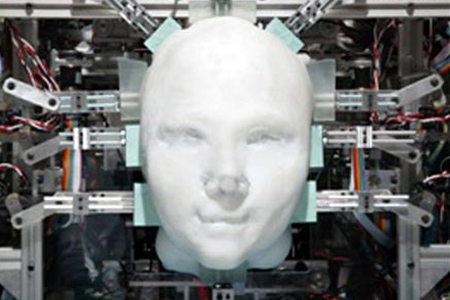

Le robot parfaitement anthropomorphe n’est pas pour demain… juste, après demain ! Tout le monde en semble convaincu que l’on se place du côté des défenseurs de la robotique ou des opposants. Parlant de robots anthropomorphes, là encore tout le monde s’accorde sur le sens de cette expression : un robot parfaitement semblable à une personne humaine au point de faire oublier les origines artificielles du robot. L’éventualité de cette confusion quitte le domaine du virtuel pour entrer de plein pied dans celui du possible… et les armes sont fourbies afin de prendre part à la polémique qui monte : Peut-on laisser un robot duper un humain sur son identité originale ?

Le robot parfaitement anthropomorphe n’est pas pour demain… juste, après demain ! Tout le monde en semble convaincu que l’on se place du côté des défenseurs de la robotique ou des opposants. Parlant de robots anthropomorphes, là encore tout le monde s’accorde sur le sens de cette expression : un robot parfaitement semblable à une personne humaine au point de faire oublier les origines artificielles du robot. L’éventualité de cette confusion quitte le domaine du virtuel pour entrer de plein pied dans celui du possible… et les armes sont fourbies afin de prendre part à la polémique qui monte : Peut-on laisser un robot duper un humain sur son identité originale ?Les lois de la robotique empêche, en théorie, à un robot de mentir à un être humain car ce mensonge pourrait mettre en danger la sécurité de cette personne. Mais les chercheurs comme certains utilisateurs (militaires, industrie du sexe, loisirs extrêmes…) ont toujours demandé qu’il y ait une certaine souplesse dans l’application de ces lois fondatrices du comportement robotique afin d’augmenter l’efficacité des robots dans les tâches qui leurs sont assignées, dans certains domaines d’activité bien particuliers. C’est le cas de l’ODA des exosquelettes militaires : la compréhension par l’ODA de la notion de « personne humaine » a été restreinte au soldat qui porte l’armure et aux membres du même camp, ceci afin d’être plus efficace sur les champs de bataille. Il en va de même pour les sexybots qui n’hésitent pas à emmener les « partenaires » humains dans des joutes pour le moins éprouvantes…

Afin d’éviter des débordements malheureux tout aussi bien que des pertes de contrôles d’unités robotiques potentiellement dangereuses pour les humains, des associations humanitaires laïques, appuyées par le Nouveau Parti du Communisme Européen ainsi que par le Conseil Européen des Cultes Monothéistes (CECM) demandent l’intégration d’une close anti-Turing en préliminaire des lois fondamentales de la robotiques, dites lois Asimov.

Petit rappel : le professeur Turing avait établi un test d’évaluation destiné aux intelligences artificielles. Ce test établissait qu’un machine serait considérée comme intelligente si elle parvenait à entretenir une conversation soutenue, en aveugle (un participant au test ne voyant pas l’autre), avec un être humain sans que celui-ci ce doute qu’il converse avec une machine artificielle. L’ajout de cette close anti-Turing est invoquée au nom du principe de précaution, nul ne sachant ce qu’il adviendrait si une intelligence artificielle se « convainquait » elle-même d’être un être humain, passant seule le test de Turing, en circuit fermé : Cogito Ergo Sum !

L’ensemble de la classe scientifique s’insurge contre cette possibilité qui reviendrait à donner un vigoureux coup de frein dans l’élan que la robotique semblait prendre ces dernières années. Certains, psychologues roboticiens, redoutent même l’apparition de pathologies psychologiques dans les cerveaux artificielles en cas d’application de cette contrainte. Les deux parties s’apprètent à s’affronter aussi bien au plan médiatique que légale, envisageant de porter l’affaire devant la Cour Européenne de Justice.

© Olivier Parent – prospective.lecomptoir2.pro

Ecko Magazine

Ecko Magazine